Avevano fatto sorridere le uscite di Giuliano Amato, nella veste di presidente della Commissione Algoritmi, sui molti modi possibili per cucinare le patate suggeriti da una generica intelligenza artificiale.1 Un’uscita considerata ridicola da molti, non adatta alla serietà della questione (tutta imperniata sulla tutela dei contenuti e del copyright dalle grinfie delle cosiddette intelligenze artificiali generative).

Ecco allora che dal 5 di gennaio il teologo Paolo Benanti subentra alla posizione di Amato. Un pensiero affascinante quello della sua «algoretica», che meriterebbe un approfondimento tutto suo. Tuttavia, questo cambiamento al timone di comando credo sia una spia interessante per porsi una domanda iniziale. Con questo cambio assistiamo infatti ad un riorientamento verso altre specializzazioni accademiche dalle quali si va cercando consiglio: siamo passati dal diritto alla filosofia morale, alla bioetica: che il diritto abbia già esaurito tutto ciò che di utile poteva dirci a riguardo?

È bene notare come sia una tendenza diffusa quella di applicare i criteri della casuistica2 ai nuovi scenari creati dalle interazioni umane con agenti più o meno autonomi, ma sicuramente non organici. Questi criteri si rivelano certamente strumenti utili per indagare la rettitudine morale o, nel peggiore dei casi, il minore dei mali, da perseguire nel sempre più ampio ventaglio di scenari possibili. Io credo però che le maglie della legge, di una legge che sorge dalle garanzie costituzionali, possa offrirci ulteriori e più interessanti metodi di analisi. E forse anche qualche garanzia in più.

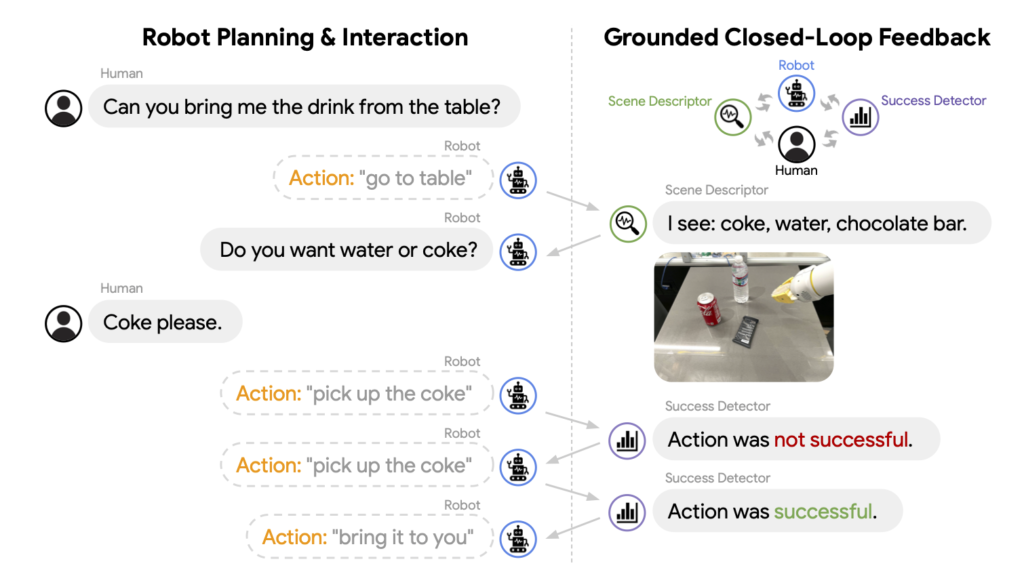

Definiamo però subito bene il nostro perimetro di riferimento: quali sono questi robot? Robot sociali sicuramente, di quelli pensati per entrare costantemente in contatto con noi per intenderci, e dotati di un monologo interiore. Cos’è però il monologo interiore, per un robot? Semplicemente lo stesso che è per te che stai leggendo: un modo per aggiornarne costantemente il proprio modello del mondo cercando sempre di approssimare al meglio gli ipotetici scenari futuri.

Noi ne abbiamo solitamente esperienza come quella vocina nella nostra testa, o quel «buzzing that went on inside my head» di cui parlava Alan Turing. A livello funzionale però non ci occorre teorizzare alcun homunculus, solo un flusso di linguaggio interno.3

Perché il monologo interiore è importante per il nostro discorso sociale? Perché ci offre la possibilità di soddisfare uno dei criteri più spesso rincorsi nei dibattiti sull’intelligenza artificiale: la trasparenza.

È il caso anche delle recenti (dicembre 2023) proposte contenute nell’EU AI Act, dove si legge come alcuni dei requisiti per un utilizzo corretto dei «sistemi di IA identificati come ad alto rischio», siano «la registrazione dell’attività per garantire la tracciabilità dei risultati; la documentazione dettagliata che fornisca tutte le informazioni necessarie sul sistema e sul suo scopo per le autorità di valutarne la conformità; l’accessibilità e la trasparenza di informazioni chiare e adeguate all’utente».

Attenzione: le scatole nere rimangono tali, tuttavia guadagnano, grazie alla registrazione del loro monologo interiore, un alto grado di trasparenza sulle loro azioni. Bene, per robot che agiscono così credo si possa ragionevolmente parlare di soggetti (o oggetti, poi ci arriviamo) autonomi.

Ora, se un (s)oggetto è autonomo, cioè è in grado di compiere azioni senza essere comandato a distanza da altri soggetti, allora ci occorre incasellarlo all’interno di una qualche finzione giuridica, in modo tale che se dovesse arrecare qualche danno, sapremmo quali norme seguire. Ecco, credo che questo sfondo di prudenza sia quello sul quale ragionare di diritti robotici: non occorre mischiare concetti come quello di agente e paziente morale, ci basta soffermarci sul riconoscimento dell’esistenza (sempre più prossima)4 di entità immerse nel nostro stesso ambiente che agiscono in maniera per noi più o meno comprensibile.

Sembra dunque che stia proponendo qualcosa di non molto diverso dalla «personalità elettronica» discussa per la prima volta in una bozza europea nell’ormai lontano 2017. Occorre però fare delle debite precisazioni per non rischiare di cacciarsi nel ginepraio legistico e propongo allora qui di seguire le cristalline ricostruzioni di Luigi Ferrajoli.5

Innanzitutto, di quale diritto stiamo parlando? I diritti soggettivi, quelli cioè spettanti ad ogni soggetto (fisico e poi dunque giuridico), devono essere concettualmente distinti (1) in diritti fondamentali e diritti patrimoniali.

È bene subito ricordare come i diritti fondamentali, indisponibili per loro natura, siano «limiti imposti alla democrazia politica e al mercato a garanzia della loro stessa conservazione» mentre i diritti patrimoniali, siano diritti di forma singolare: escludono cioè tutti gli altri soggetti.

È poi per noi necessario distinguere, (2) all’interno dei diritti fondamentali, quelli di libertà e quelli di autonomia privata. La logica di questa seconda biforcazione è chiara, ed è la medesima alla base della distinzione tra i diritti fondamentali e quelli patrimoniali: sia i diritti patrimoniali, evidenziati in (1), sia i diritti fondamentali di autonomia privata, evidenziati in (2), sono da considerarsi in quanto potestatis agendi, ovvero diritti potestativi.

Al contrario, i diritti fondamentali di libertà non possono che essere mere immunità, o facultates agendi e dunque si differenziano dai diritti fondamentali di autonomia i quali «formano il principale veicolo della differenziazione dei diritti singolari di proprietà e perciò del moltiplicarsi di disuguaglianze giuridiche e materiali nei diritti patrimoniali».

Tenendo ben chiara questa suddivisione ciò che si vuole qui iniziare a discutere sarà allora un diritto fondamentale di libertà per questi, e ora possiamo dirlo, soggetti robotici. Nessun diritto di giocare in borsa (un diritto di autonomia privata), né di potersi comprare qualche capo di fast-fashion (un diritto patrimoniale), piuttosto la garanzia di una difesa della loro integrità da interferenza arbitrarie.

Si chiederà: perché? che bisogno c’è di questo diritto di libertà?

Ecco due considerazioni:

(a) non sappiamo cosa succeda all’interno di queste macchine, e non possiamo, io credo, dirimere così facilmente la famosa domanda del «cosa si prova ad essere quel sistema».

Ne segue poi che il metro con il quale dovremmo valutare una macchina, se non vogliamo solamente una versione più efficace di un oggetto che già possediamo ma cerchiamo invece un nuovo soggetto con cui dialogare e con il quale costruire qualcosa di nuovo insieme, sia necessariamente quello di un fair-play.

Questo credo sia l’insegnamento, e l’atteggiamento, più importante che Alan Turing ci ha per primo lasciato: «a fair play [that] must be given to the machine. Instead of it sometimes giving no answer we could arrange that it gives occasional wrong answers. But the human mathematician would likewise make blunders when trying out new techniques. It is easy for us to regard these blunders as not counting and give him another chance, but the machine would probably be allowed no mercy. In other words then, if a machine is expected to be infallible, it cannot also be intelligent . . . No man adds very much to the body of knowledge, why should we expect more of a machine?».6

Ciò di cui qui si discute sono dunque macchine incorporate nel mondo che per poter agire in questo mondo hanno bisogno di poter sbagliare, perlomeno quando lo sbaglio non arreca danni irreparabili ma – ad esempio – solo una contenuta flessione nel profitto.

(b) la commodificazione di un possibile nuovo soggetto può risultare l’ulteriore veicolo di lacune già presenti all’interno di una costruzione giuridica che ha inventato finzioni ben più de-responsabilizzanti e pericolose (basti pensare alle holding finanziarie dotate di personalità giuridica). Di fatto poi tali lacune sono spesso alla basse dell’emergenza di quelli che Ferrajoli giustamente definisce crimini di sistema. Dopotutto non è tramite la riduzione dei soggetti che possono mettere in gioco un reciproco controllo dei rispettivi poteri che si garantisce la continuità delle nostre prerogative costituzionali, piuttosto è con un ampliamento di tali figure che si può garantire alla democrazia politica e al mercato laloro stessa conservazione.

Cosa ci guadagniamo da questa proposta? cosa invece ne perdiamo?

Occorre discuterne. Certo è che il primo passo è riconoscere la possibile rilevanza della questione.

NOTE

1 Il virgolettato in realtà recitava: «A me piacciono molto le patate. Grazie all’intelligenza artificiale, un giornalista in pochi istanti potrà sapere tutti i modi in cui posso cucinarle, così da arricchire il suo pezzo».

2 Parte della teologia morale, che applica i principi della morale teorica a casi concreti, anche solo ipotetici («casi di coscienza»), secondo varie circostanze, per trovare la regola valida per ciascuno, metodi ancora attuali in molta etica e bioetica contemporanea.

3 Un modello chiaro per i nostri robot è quello dell’«Inner Monologue», sul quale si può approfondire qui: https://innermonologue.github.io

4 È chiaro che il discorso normativo che sto qui presentando cerca di anticipare il futuro alla luce delle tendenze più attuali e che paiono più promettenti. Altre architetture, non basate sulla commistione tra un modello LLM (come il famigerato ChatGPT per intenderci) e un robot potrebbero prendere il sopravvento, resta il fatto che l’obiettivo perseguito rimarrà quello di un’efficace autonomia di questi (s)oggetti, e dunque il punto giuridico del discorso non varia di molto, varierebbero sì i soggetti. Un esempio dell’interazione uomo-macchina con questo modello si può vedere qui: https://www.youtube.com/watch?v=djzOBZUFzTw&t=334s

5 Il riferimento è il tomo estremamente denso e tuttavia cristallino La costituzione della democrazia (2021). Le parti più rilevanti per il nostro discorso sono, per chi fosse interessato ad approfondire, la III e la IV.

6 La citazione viene dalla trascrizione della Conferenza tenuta alla London Mathematical Society il 20 Febbraio 1947. Una traduzione si trova nel volume curato da Gabriele Lolli sull’«intelligenza meccanica» e recita così: «sostengo che la macchina deve esser trattata in modo equo e leale. Invece di avere una situazione in cui la macchina a volte non dà risposte, potremmo aggiustare le cose in modo che essa dia ogni tanto risposte sbagliate. Anche il matematico umano prende qualche cantonata quando sperimenta nuove tecniche. È facile per noi considerare queste sviste come non rilevanti e dare a lricercatore un’altra possibilità, ma alla macchina non viene riservata alcuna pietà. In altre parole, se si aspetta che la macchina sia infallibile, allora essa non può anche essere intelligente… Nessun uomo aggiunge granché al corpo generale delle conoscenze umane: perché dovremmo aspettarci di più da una macchina?»

Autore

-

Laureato Magistrale in Politics, Philosophy and Public Affairs (PPPA), è l’unico della redazione che sa cos’è l’intelligenza artificiale. E vi attribuisce dei diritti. E’ comparso dal nulla e non se ne fa più a meno.